|

|

|

Архитектура Астрономия Аудит Биология Ботаника Бухгалтерский учёт Войное дело Генетика География Геология Дизайн Искусство История Кино Кулинария Культура Литература Математика Медицина Металлургия Мифология Музыка Психология Религия Спорт Строительство Техника Транспорт Туризм Усадьба Физика Фотография Химия Экология Электричество Электроника Энергетика |

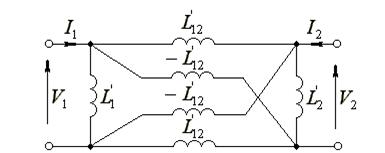

Эквивалентные модели. Модель связанных индуктивностей ⇐ ПредыдущаяСтр 3 из 3

Модель – идеализация процессов, путем отбрасывания несущественных факторов. Эквивалентные модели – среднее между физ и мат моделями

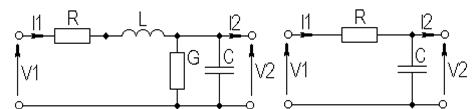

Модель распределенных структур. Обычно описываются телеграфными уравнениями (дифференц) При периодическом воздействии ур-я коэффициенты становятся постоянными. Решения таких уравнений аналитические – при раскрыве – матрица передачи Модель LC RC

Волновое сопротивление

Пост распределения

Решение систем алгебраических уравнений. Гаусс. 1 Привести к диагональному виду (вычитать верхнюю строку умноженную на обнуляемый эл-т и деленную на диагональный элемент) 2 найти Х используя обратное преобразование (находить Xn Xn-1 Xn-2…) Для обратной матрицы X=Y*A-1 Гаусс-Жордан. Все в один заход: Строку нормируем и вычитаем ее из других строк(и верхних тоэже), потом следующую… в результате получаем 1-ю матрицу и Y-ки результаты. Схема Халецкого LU факторизация

Сначала находятся Z прямой подстановкой сверху вниз Потом по Z находят Х подстановкой снизу вверх.

LU факторизация Краутом

Знаем 1-й сто, определяем 1-ю стр, определяем 2-й сто, опр 2 стр … Это и есть алгоритм факторизации(разложения) Краута Метод ортогонализации (QR-факторизации) X Y орто если их скалярное произведение =0 По сто

R – орто по сто Q – верхнетреугольная с единичной диагональю

обратный ход Гаусса ПО СТРОКАМ

Q – нижнетреугольная 1 диаг R – орто по стр

QRФактори Грамм Шмидт по сто

Представим А и R в виде матрицы векторов столбцов:

QR Грамм Шмидт по стр

Тоже самое Рассчет цепей по постоянному току. Алгоритм Ньютонка-Рафсонка. На постоянном токе – нелинейные э исп нелинейные статические хар-ки. Кондеры и катушки исключаются. Используются итерационные методы(Назин). Н-Р алгоритм: Для решения нелинейного f(x)=0

k- номер итерации В сложных схемах таких уравнений целые системы

Пренебрежем членами высшего порядка

Матрица Якоби Результат Х – неточен из-за пренебрежения но если повторять решение то погрешность уменьшается:

Собственно алгоритм НР

Поиск по сайту: |

- вспомогательный вектор

- вспомогательный вектор

D – диагональная

D – диагональная

-

-